Data engineering in our current era enjoys a great deal of interest and unprecedented demand, as many believe that it will be the most important science in the near future and will occupy a prominent place within the family of all data sciences, and even beyond that, data engineering is considered the future of artificial intelligence.

This science derives its importance as it mainly represents the backbone of data, so to speak, and rather the data infrastructure on which data science in all its branches depends.

Therefore, due to the scarcity of data engineering projects, we put in your hands five projects that will help you build a strong business portfolio that raises your chances when applying for any job related to data science.

Before moving on to the list of projects, please share this information and follow the blog in support of us to continue providing everything that is useful, and we are pleased to see your opinions and experiences in the comments .. thanks

Let’s get to know the five projects:

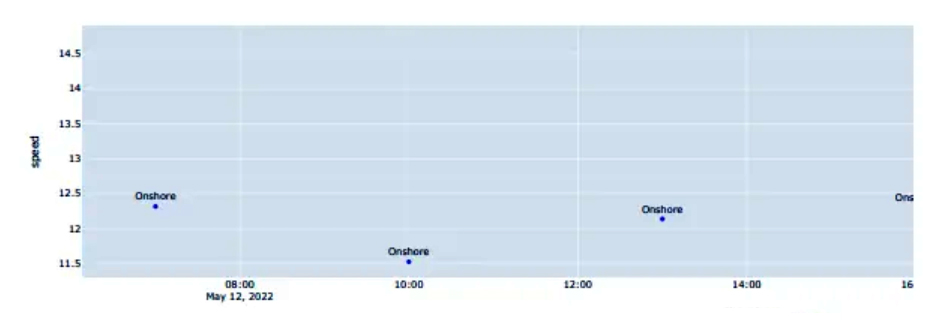

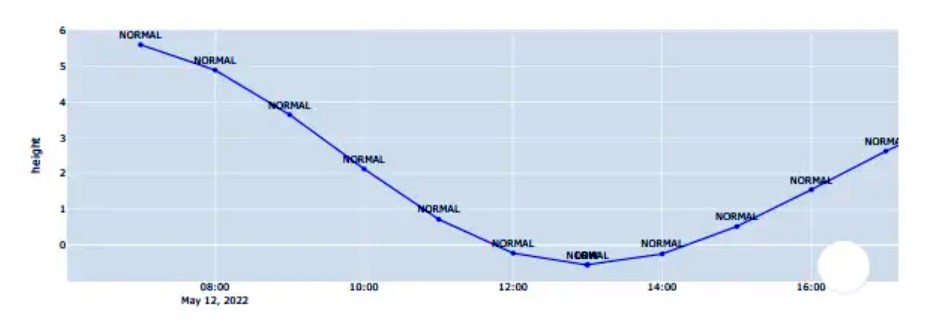

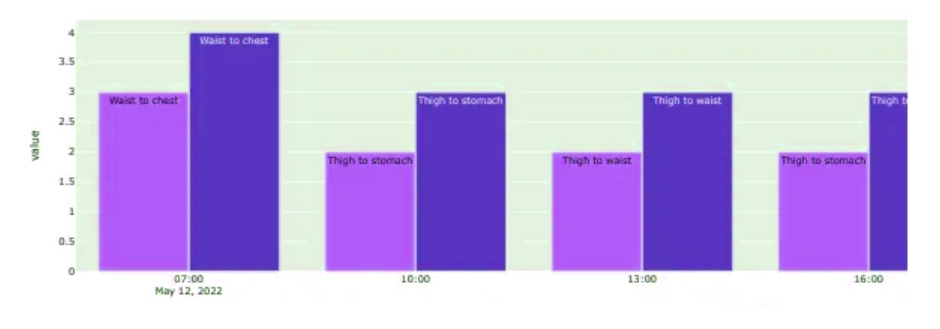

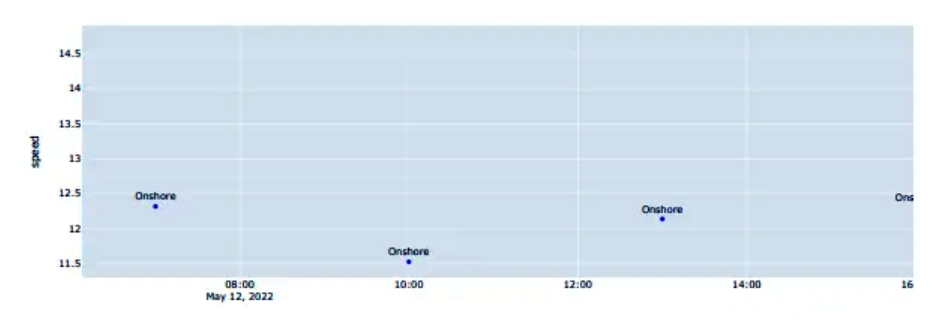

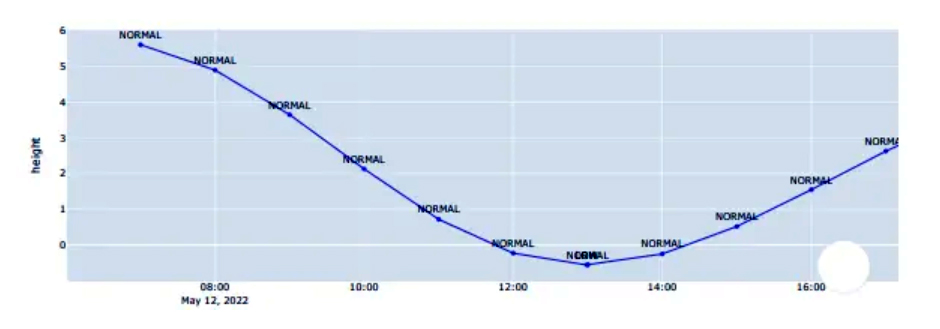

1. Surfline Dashboard

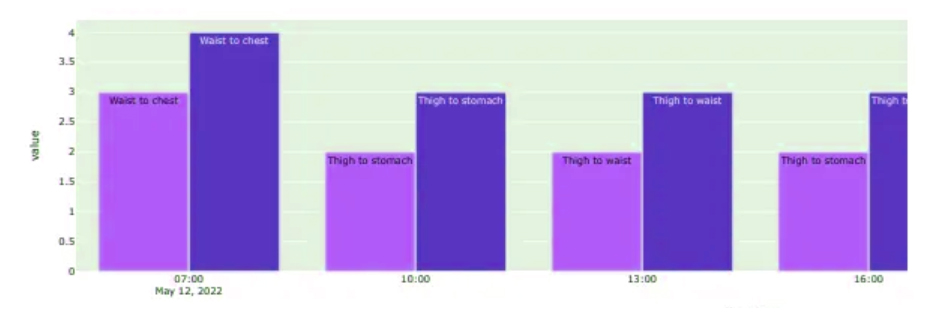

What you will learn in this project You will collect data from Surfline API via pipeline and export CSV file to Amazon S3

The goal of this project is to have a nice dashboard showing the data and to that end it loads the latest file into S3 to eventually feed it into the Postgres data warehouse

2. Audiophile End-To-End ELT Pipeline

The implementation of this project requires the creation, design, and management of a data pipeline that will extract data from Crinacle’s Headphone and InEarMonitor databases and finalize metabase dashboard data.

You will learn AWS S3, Redshift, RDS, data transformation tool dbt, streaming

3. The FinnHub Streaming Data Pipeline

The aim of this project is to provide users with real-time financial data through a solid foundation

You will deal with building and implementing a data architecture that will handle big data in real time and stream data pipelines based on FinnHub.io API which is WebSocket which is used for real time handling data.

You will learn, for example:

Apache Kafka, Spark, Cassandra, Kubernetes and Grafana

4- Twitter data pipeline using Airflow

Through this project you will learn the main principles of Airflow and the skills of creating a data pipeline

In a big data environment, the concept of data pipeline is automatically associated with data engineering, and data engineering mastery is associated with mastery of data pipeline skills

You will also learn:

- Python for DE

- Airflow Basics

- Working with Tweepy

- Twitter Data Package

- Writing ETL functions

- Data storage on Amazon S3

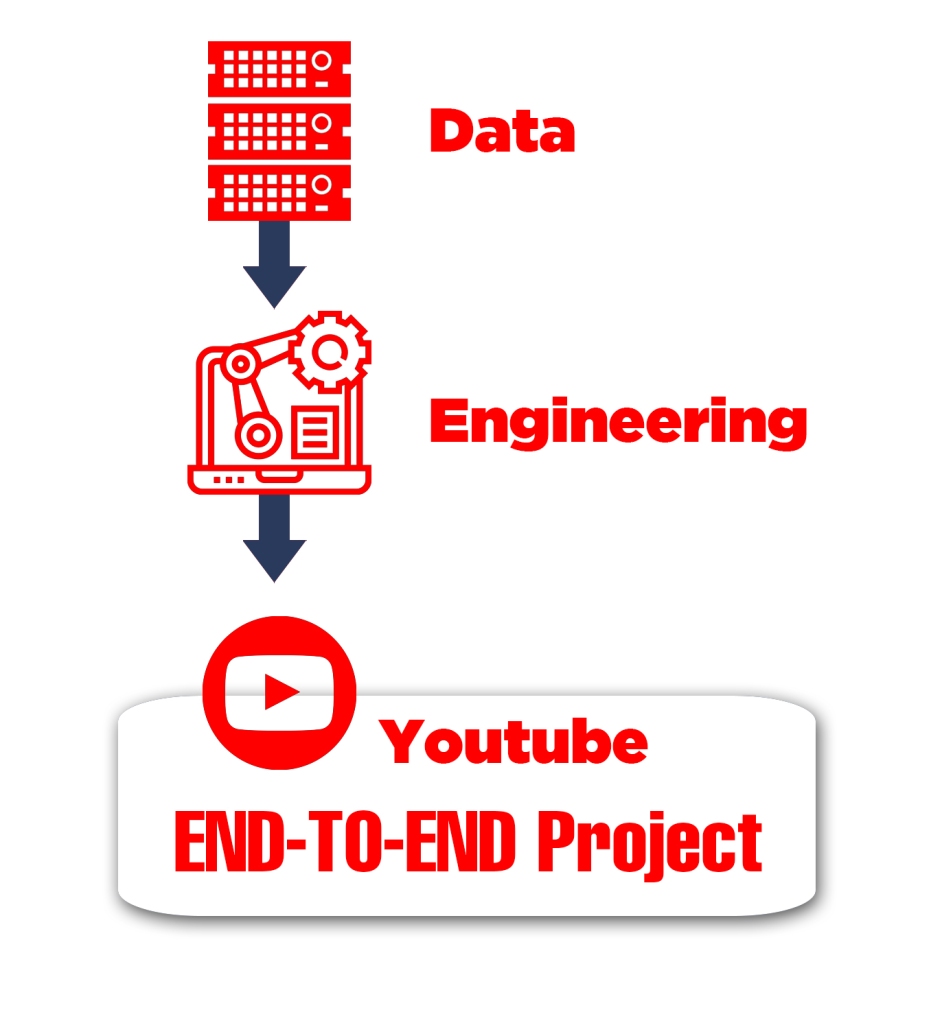

5. Youtube data engineering project from start to finish

Frankly, this project carries a great benefit, so do not skimp on yourself by enriching your information and raising your scientific balance in data engineering, in addition to learning how to understand problems and address them, so you will implement a complete data engineering project, and the implementation will take you about three hours.

You will follow the trainer’s instructions step by step, highlighting the important points and necessary details

خمسة مشاريع مجانية لهندسة البيانات تبني بها محفظة أعمال عالية المستوى

تحظى هندسة البيانات في عصرنا الحالي بحيزٍ كبيرٍ من الاهتمام والإقبال غير المسبوق حيث أن الكثيرين يرون أنها من ستكون أهم العلوم في المستقبل القريب وستحتل مكانة مرموقة ضمن عائلة علوم البيانات كافة بل ويتعدى ذلك إلى اعتبار هندسة البيانات مستقبل الذكاء الاصطناعي

يستمد هذا العلم أهميته باعتبار أنه يمثِّل بشكل رئيسي عصب البيانات إن صح التعبير وبالأحرى البنية التحتية للبيانات التي تعتمد عليها علوم البيانات بكافة فروعها

لذا ونظراً لندرة توفر مشاريع هندسة البيانات، نضع بين أيديكم خمسة مشاريع تساعدك على بناء محفظة أعمال قوية ترفع من حظوظك عند التقدم لأي وظيفة تتعلق بعلوم البيانات

قبل الانتقال إلى قائمة المشاريع الرجاء مشاركة هذه المعلومات ومتابعة المدونة دعماً لنا للاستمرار بتقديم كل ما هو مفيد، كما ويسعدنا مشاهدة آراءكم وتجاربكم في التعليقات.. مع جزيل الشكر

:هيا بنا لنتعرف على المشاريع الخمسة

1. Surfline Dashboard

ما ستتعلمه في هذا المشروع بأنك ستقوم بتجميع البيانات

عبر خط الأنابيب Surfline API من

Amazon S3 إلى CSV وتصدير ملف

الهدف من هذا المشروع هو الحصول على لوحة معلومات رائعة تعرض البيانات وللوصول إلى هذه الغاية يتقوم بتحميل أحدث ملف في S3 ليتم في نهاية المطاف إدخاله في مستودع بيانات Postgres

2. Audiophile End-To-End ELT Pipeline

يتطلب تنفيذ هذا المشروع إنشاء وتصميم وإدارة خط أنابيب البيانات التي ستقوم باستخراج البيانات

Crinacle’s Headphone من قواعد البيانات

InEarMonitorو

وإنهاء بيانات لوحة بيانات قاعدة التعريف

ستتعلم

AWS S3 ، Redshift ، RDS ،

التدفق ،dbt أداة تحويل البيانات

3. The FinnHub Streaming Data Pipeline

الهدف من هذا المشروع هو إمداد المستخدمين ببيانات مالية في الوقت الفعلي من خلال قاعدة متينة سوف تتعامل مع بناء وتنفيذ بنية البيانات التي بدورها ستتعامل مع بيانات ضخمة في الوقت الفعلي كما وستقوم بتدفق خطوط أنابيب البيانات

WebSocket وهو FinnHub.io API استناداً على

والذي يستخدم لبيانات التعامل في الزمن الحقيقي

سوف تتعلم على سبيل المثال لا الحصر:

Apache Kafka, Spark, Cassandra, Kubernetes and Grafana

4- Twitter data pipeline using Airflow

من خلال هذا المشروع

Airflow ستتعلم المبادئ الرئيسية لـ

ومهارات إنشاء خط أنابيب البيانات

في بيئة البيانات الضخمة يرتبط مفهوم خط أنابيب البيانات تلقائياً بهندسة البيانات ويعتبر احتراف هندسة البيانات مقروناً بإتقان المهارات المتعلقة بالتعامل مع خط أنابيب البيانات

: ستتعلم أيضاً

Python for DE

Airflow أساسيات

Tweepy والعمل مع

Twitter Data Package

ETL كتابة وظائف

Amazon S3 تخزين البيانات على

5. من البداية إلى النهاية Youtube مشروع هندسة بيانات

بصراحة هذا المشروع يحمل فائدة كبيرة لذا لا تبخل على نفسك بإغناء معلوماتك ورفع رصيدك العلمي في هندسة البيانات إضافة إلى تعلمك كيفية فهم المشاكل ومعالجتها لذا فستقوم بتنفيذ مشروع هندسة بيانات كامل وسيستغرق معك التنفيذ حوالي ثلاث ساعات

ستتَّبِع تعليمات المدرب خطوة بخطوة مع الوقوف على النقاط الهامة والتفاصيل الضرورية